L'IA à l'ère du taylorisme 2.0 : Les impacts néfastes sur l'organisation du travail

L’IA à l’ère du taylorisme 2.0 : Les impacts néfastes sur l’organisation du travail

Article mis à jour le 18 septembre 2025.

Face à la généralisation des outils d’intelligence artificielle dans les entreprises, le débat se déplace du « combien d’emplois » au « comment travaille-t-on ». En 2025, selon les experts, une analyse approfondie révèle une transformation silencieuse : standardisation des tâches, parcellisation des gestes métier et chronométrage précis par capteurs et logiciels. Ce mouvement, qualifié par plusieurs chercheurs de taylorisme 2.0, touche les entrepôts, les services, mais aussi les professions qualifiées, et réorganise la chaîne de décision autour d’outils de ContrôleDigital et de GestionAutomatisée. Il est essentiel de considérer les effets collatéraux sur l’autonomie, la santé et le sens du travail.

De grandes études sur l’évolution de l’IA et la relation humain-machine, les dispositifs publics comme LaborIA, ou encore l’analyse de Frédéric Fréry sur le retour des logiques tayloriennes chez Xerfi Canal, convergent : la promesse d’EfficienceArtificielle s’accompagne d’un TravailQuantifié en continu. Comment éviter que l’IA ne réduise l’expertise au rang d’« appendice » et organise un taylorisme 2.0 à grande échelle ?

IA et taylorisme 2.0 : impacts néfastes sur l’organisation du travail

Les principes fondateurs de Taylor — séparation entre conception et exécution, prescriptions détaillées, mesure des temps — trouvent une extension algorithmique. Selon les experts, cette reconfiguration se lit dans l’essor du ContrôleDigital des flux et du TravailQuantifié par KPI. Une analyse approfondie révèle que la quête d’EfficienceArtificielle peut se traduire par une perte d’autonomie décisionnelle, y compris dans des métiers hautement qualifiés, comme l’a montré la littérature sur un siècle d’organisation du travail rappelée par Cairn.

- Parcellisation via consignes minute par minute pilotées par un moteur type AlgorithmePro.

- SurveillanceIA avec scoring en temps réel et alertes automatiques.

- GestionAutomatisée des plannings limitant la marge de manœuvre des équipes.

- Pression d’OptimisationSmart favorisant l’exécution au détriment de l’initiative.

Pour éclairer ces bascules, il est essentiel de considérer la recherche-action de LaborIA et l’analyse de Fréry sur l’historicité taylorienne des technologies chez Xerfi. Point nodal : la technologie amplifie une logique déjà connue.

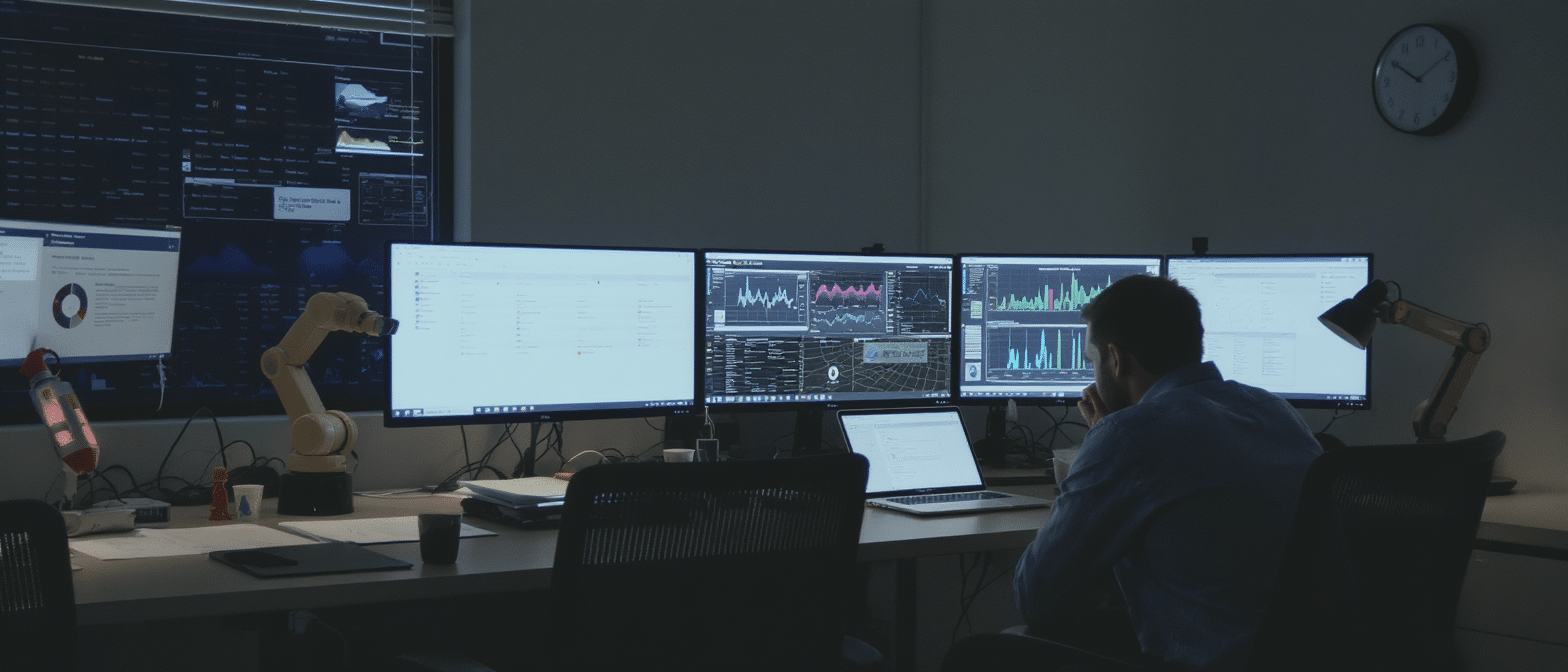

Surveillance numérique et TravailQuantifié à l’ère du taylorisme 2.0

Chez « LogiNord », un entrepôt fictif inspiré de pratiques observées, des bracelets connectés et une application de GestionAutomatisée assignent les trajets, tandis qu’un tableau de ProductivitéConnectée classe les opérateurs. Selon les experts, la surveillance des employés s’inscrit dans une tradition managériale qui réapparaît sous des habits numériques. Une analyse approfondie révèle que ces dispositifs, adossés à AlgorithmePro, renforcent le ContrôleDigital et réduisent le temps consacré au feedback qualitatif.

- Indicateurs suivis : temps par geste, micro-pauses, taux d’erreurs (TravailQuantifié).

- Outils : caméras, capteurs portés, scripts de OptimisationSmart.

- Effets : autocensure, réduction de l’entraide, intensification invisible.

Pour des repères méthodologiques, voir aussi l’enquête du ministère sur le déploiement et le recrutement assistés par IA ici, ainsi que des analyses de management publiées sur les systèmes de contrôle.

Ces logiques nourrissent des débats nourris sur les réseaux, où se croisent retours d’expérience et critiques des métriques. Quel équilibre entre mesure et confiance managériale ?

Automatisation, déqualification et santé au travail : effets pervers de l’IA

Le tournant est net : dans de nombreux secteurs, la Robotisation360 et les assistants généraux standardisent l’activité, parfois au prix d’une déqualification. Le rapport mondial 2024 souligne les écarts d’adoption et l’ambivalence des gains. Parallèlement, les trajectoires de souffrance au travail documentées par des sociologues comme Rémy Pongé résonnent avec les effets de surcharge cognitive induits par la ProductivitéConnectée.

- Logistique : consignes dictées par AlgorithmePro et timing serré (préparateurs de commandes).

- Soins : protocoles prescriptifs, moindre latitude clinique autour d’outils de décision.

- Relation client : scripts automatisés, moindre qualité d’écoute sous la pression d’OptimisationSmart.

- Éducation/formation : risques de formatsage malgré l’essor d’usages créatifs documentés.

Il est essentiel de considérer l’impact subjectif de la digitalisation sur le rapport au travail, étudié par les sciences de gestion et dans la littérature académique. Quand l’EfficienceArtificielle devient injonction, la santé et le sens vacillent.

Soft skills et HumainAugmenté : contre-feux organisationnels

Selon les experts, miser sur les compétences socio-comportementales constitue un levier robuste face à la standardisation. L’argument est détaillé dans cette analyse sur la valorisation des soft skills à l’ère de l’IA publiée par HBR France. Côté politiques internes, des cadres de recrutement et d’évaluation s’affinent au niveau ministériel pour articuler HumainAugmenté et responsabilité.

- Former au jugement, à la collaboration et à l’éthique des données (s’appuyer sur des ressources pédagogiques).

- Concevoir des postes « IA copilote » qui libèrent du temps d’analyse, pas seulement d’exécution.

- Placer des garde-fous : droit au désaccord, traçabilité des décisions, critères qualité non chiffrés.

La clé est d’aligner les systèmes sur la mission, plutôt que d’aligner la mission sur l’outil.

Politiques publiques et gouvernance : baliser l’IA au travail contre le taylorisme 2.0

Le débat ne se gagne pas seulement dans les codages, mais dans la gouvernance. Des initiatives comme LaborIA Explorer accompagnent les organisations pour évaluer les impacts sur l’emploi, les compétences et les conditions d’exercice. Une analyse approfondie révèle que la régulation européenne des systèmes à haut risque et les chartes internes peuvent freiner les dérives de SurveillanceIA.

- Audits d’AlgorithmePro avant déploiement (biais, explicabilité, sécurité).

- Comités mixtes incluant salariés et représentants métiers dans la conception.

- Minimisation des données et limites claires au ContrôleDigital.

- Garantie d’HumainAugmenté : dernier mot à l’humain sur les décisions sensibles.

Il est essentiel de considérer que la « bonne IA » est autant un choix d’architecture sociale qu’un choix technique.

Mesurer au-delà de la ProductivitéConnectée : nouveaux indicateurs d’organisation

Le siècle dernier a montré, comme le rappelle l’histoire du travail documentée, que ce qui se mesure guide l’action. Pourquoi ne pas intégrer des métriques de qualité et d’apprentissage au même rang que les unités produites ? Cette orientation limite les effets pervers d’une ProductivitéConnectée réduite aux volumes.

- Autonomie effective (latitude de décision par mission) et coopération transversale.

- Charge cognitive et temps sans écran dédiés à l’analyse.

- Apprentissages mensuels et capacité d’innovation des équipes.

- Indicateurs de santé au travail, en lien avec les trajectoires de souffrance analysées.

La technologie devient alors un levier d’OptimisationSmart au service du travail bien fait, plutôt qu’un accélérateur de taylorisme 2.0.

Journaliste spécialisé dans la transition économique et l’entrepreneuriat, je m’attache à décrypter les évolutions industrielles et les initiatives innovantes qui façonnent notre avenir. Mon parcours m’a conduit à collaborer avec divers médias nationaux, où j’ai analysé les réformes majeures et leurs répercussions sur la société.